本人微信公众号,欢迎扫码关注!

HDFS客户端操作

1 环境准备

1.1 Jar包准备

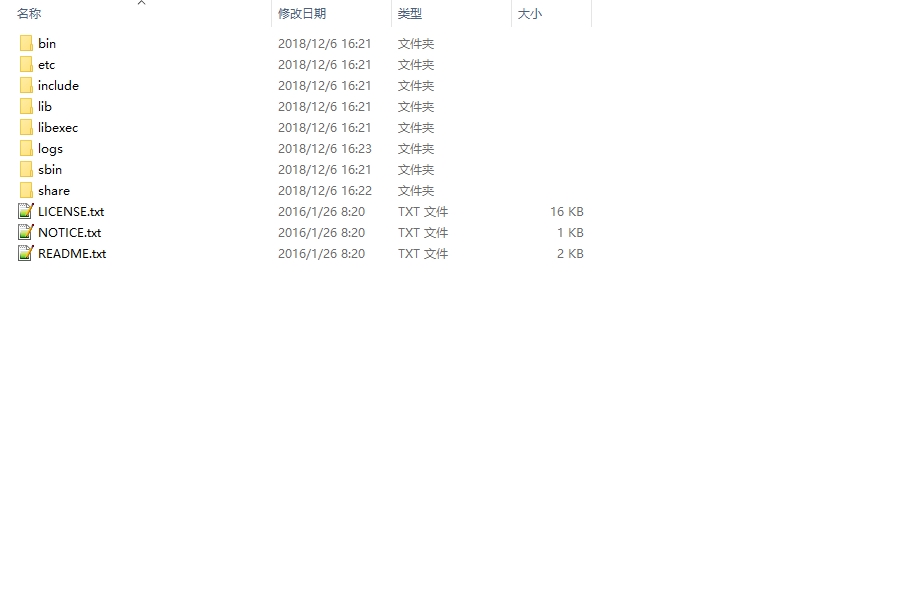

1)解压hadoop-2.7.2.tar.gz到非中文目录

注意1:如果使用WinRAR解压报错的话,就使用超级管理员权限打开DOS窗口,然后cd到解压包所在位置,执行start winrar x -y xxx.tar.gz命令,即可成功

注意2:使用对应平台下编译后的hadoop源码包,即win7系统使用在win7下编译后的源码包,win10同理。

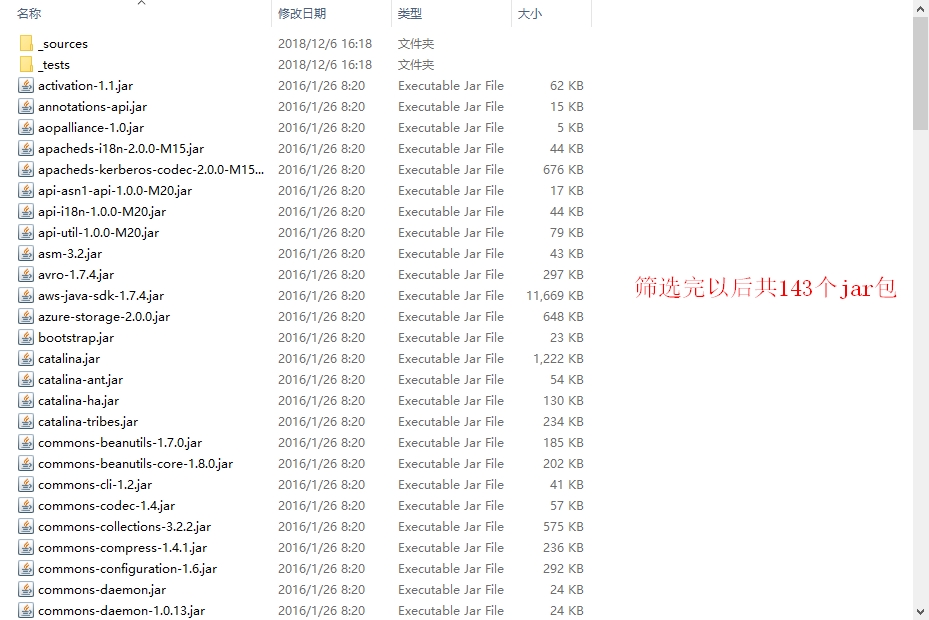

2)进入share文件夹,查找所有jar包,并把jar包拷贝到_lib文件夹下

3)在全部jar包中查找.source.jar,并剪切到_source文件夹。

4)在全部jar包中查找tests.jar,并剪切到_test文件夹。

1.2 IDEA准备

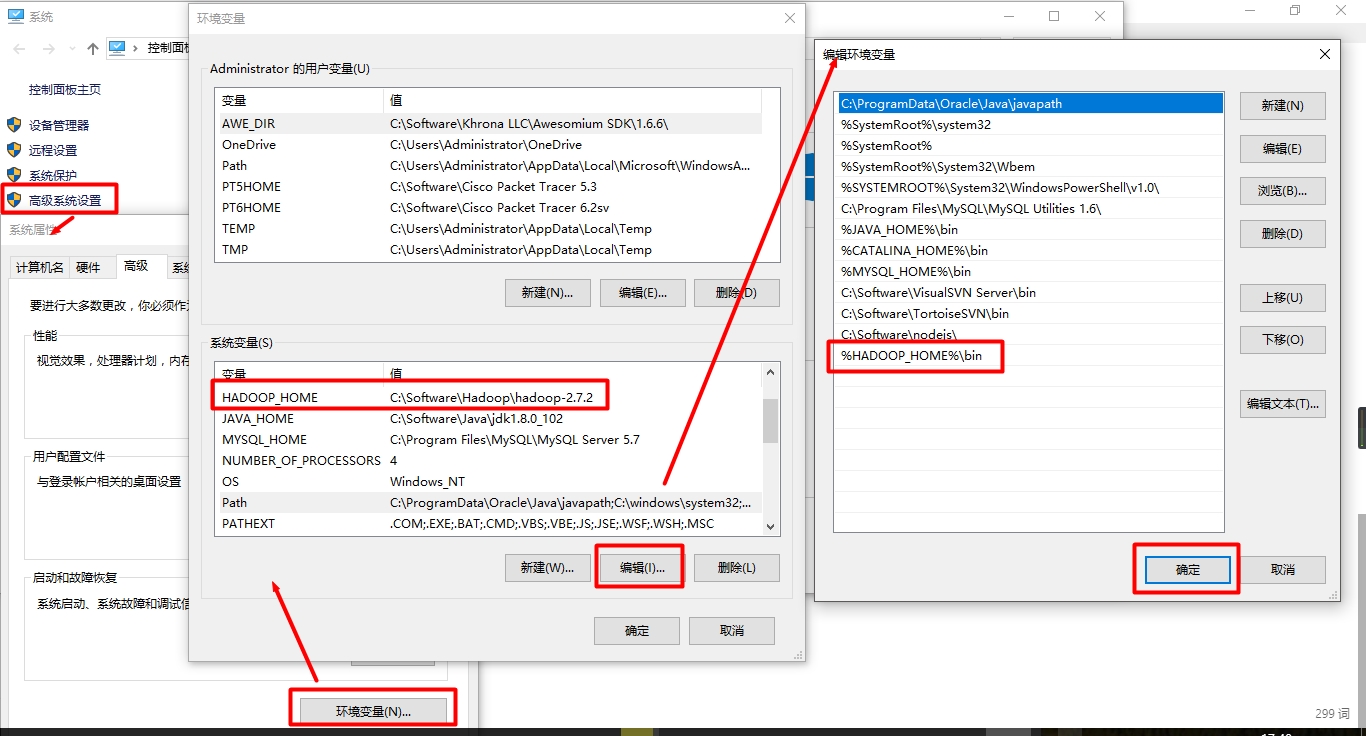

1)配置HADOOP_HOME环境变量

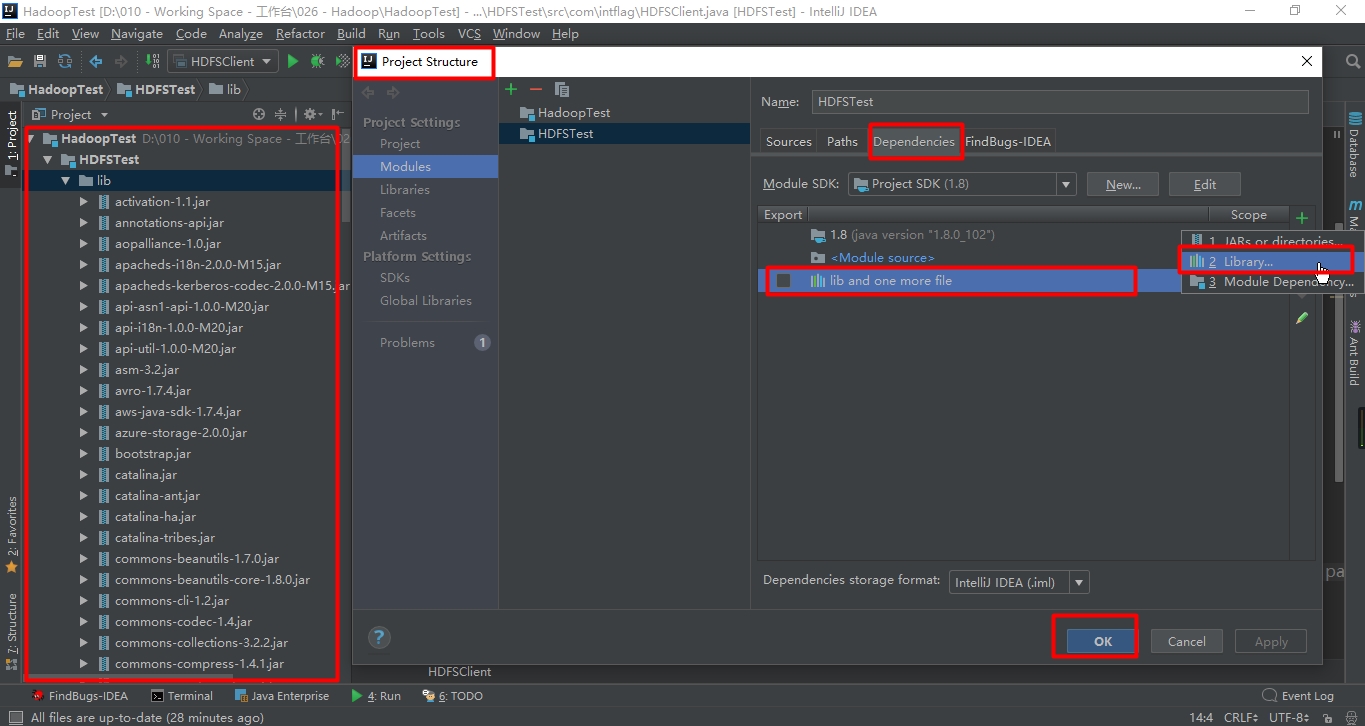

2)建立工程并且添加依赖

注意:Eclipse全选Jar包右键Add Build Path

3)编写代码测试

1 | public static void main(String[] args) { |

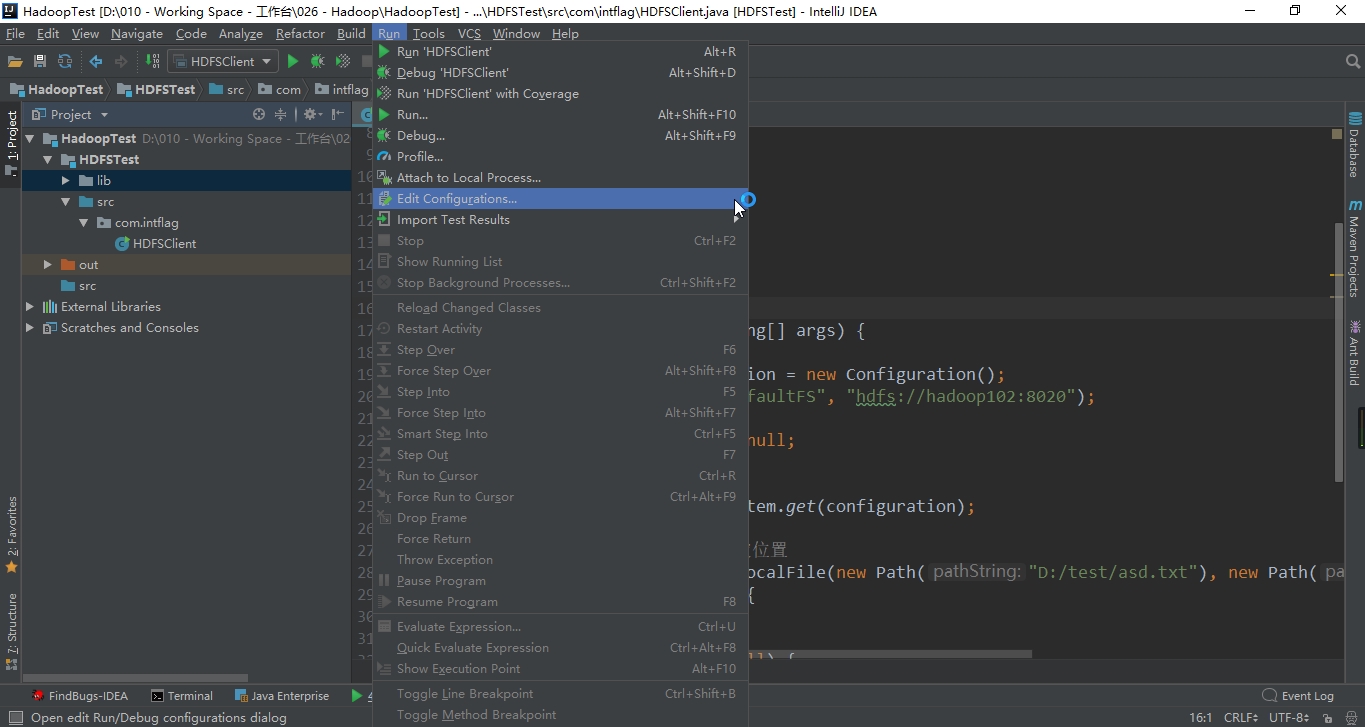

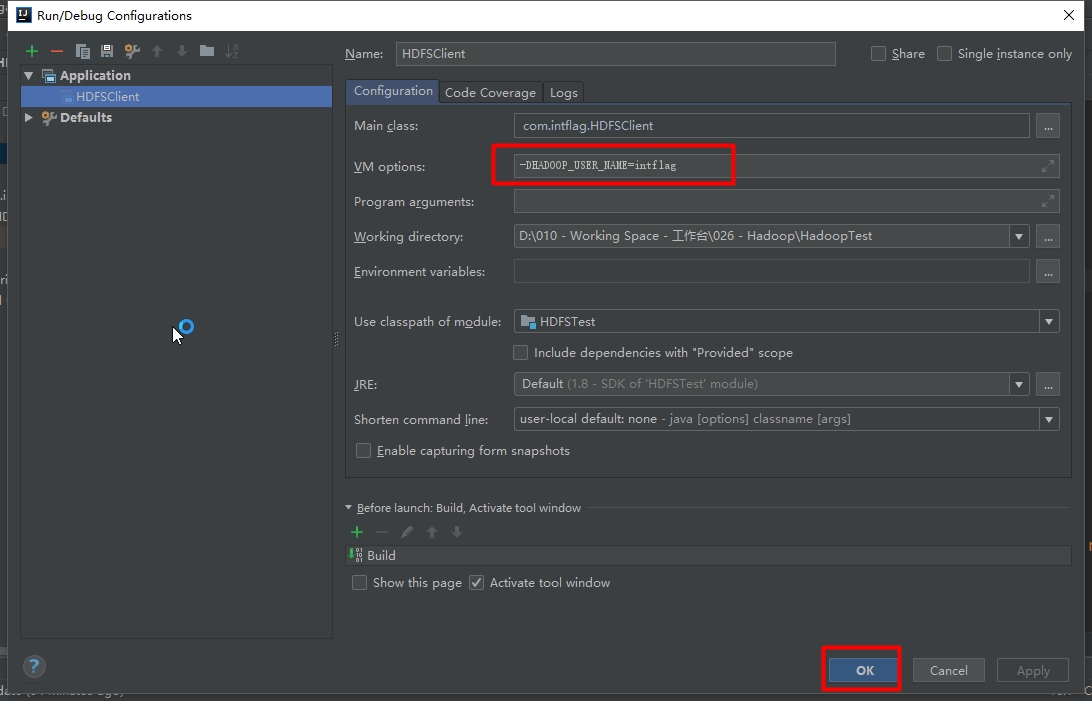

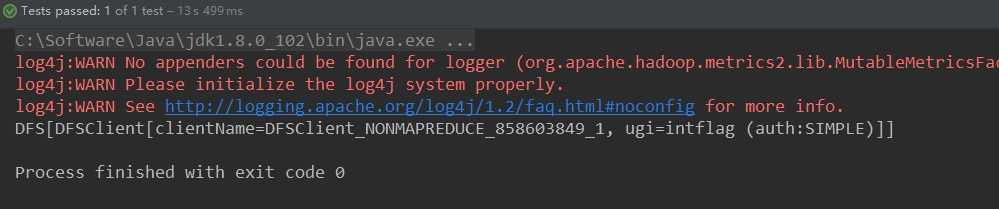

4)执行程序

客户端去操作hdfs时,是有一个用户身份的。默认情况下,hdfs客户端api会从jvm中获取一个参数来作为自己的用户身份:-DHADOOP_USER_NAME=atguigu,atguigu为用户名称。

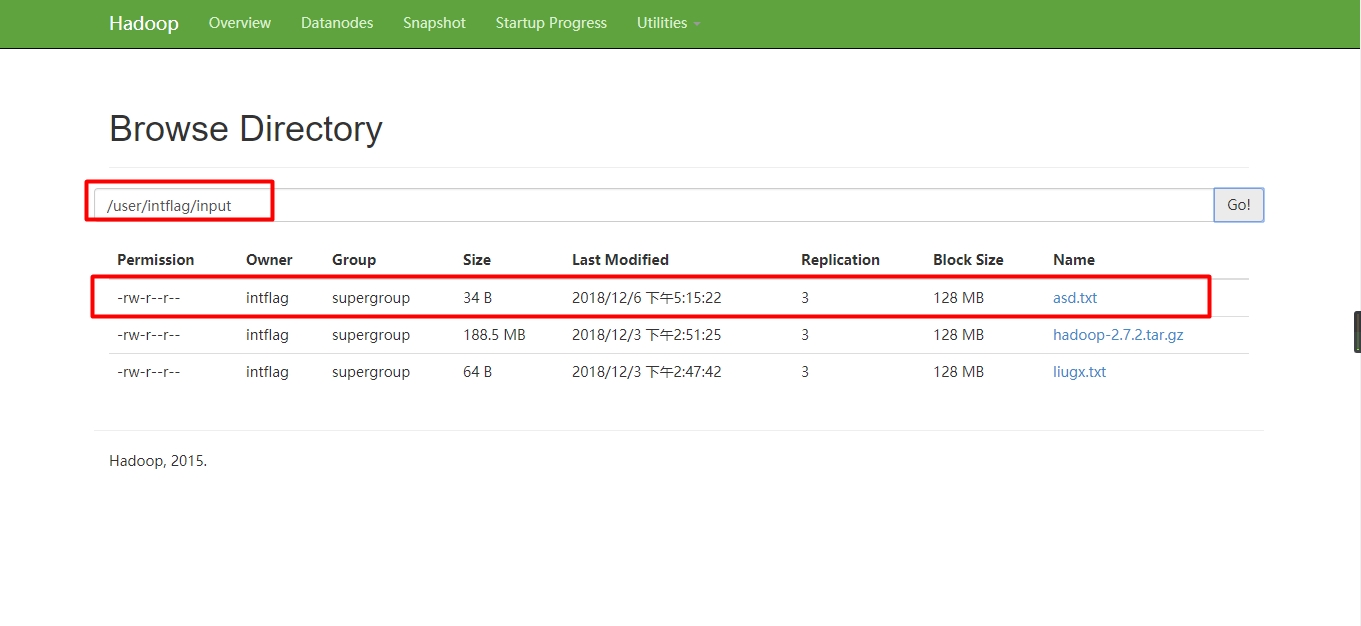

5)验证

2 通过API操作HDFS

2.1 HDFS获取文件系统

1 | @Test |

2.2 HDFS文件上传

1 | @Test |

2.3 HDFS文件下载

1 | @Test |

2.4 HDFS目录创建

1 | /** |

2.5 HDFS文件夹删除

1 | /** |

2.6 HDFS文件名更改

1 | /** |

2.7 HDFS文件详情查看

1 | /** |

1 | ----------------------------------- |

2.8 HDFS文件夹查看

1 | /** |

3 通过IO流操作HDFS

3.1 HDFS文件上传

1 | /** |

3.2 HDFS文件下载

1 | /** |

3.3 定位文件读取

下载第一块

1 | /** |

下载第二块

1 | /** |

合并文件

1 | 打开DOS窗口,定位到下载后的位置,输入以下命令合并文件 |